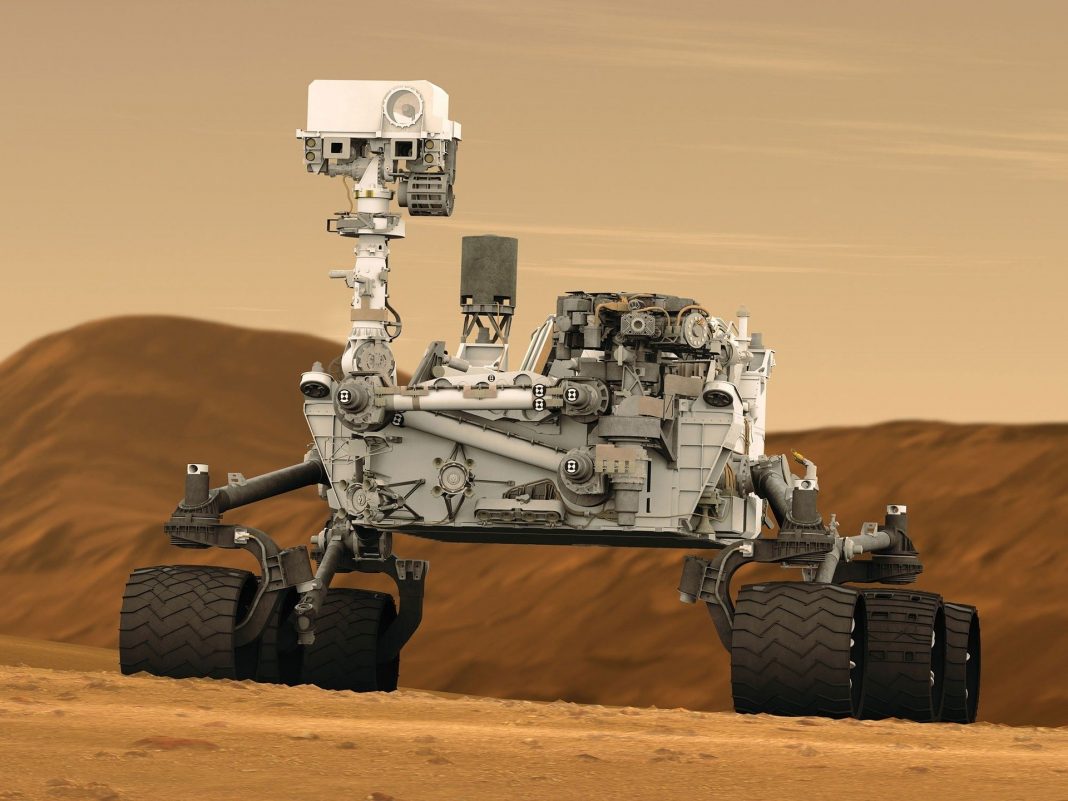

Célèbre pour ses théories sur la guerre, le Secrétaire à la Défense Américaine Jim Mattis s’interroge sur l’impact qu’auront les armes automatisées sur la guerre et sur la direction que doit prendre son gouvernement.

En effet, des intelligences artificielles de plus en plus autonomes sont déjà capables d’appuyer sur la gâchette, ce qui pose à la fois une question éthique et une menace pour l’ensemble de l’Humanité.

Les dangers de la guerre artificielle

Comme le rapporte le Times Live, la question a été soumise à un ancien Général de la Marine : « La nature fondamentale de la guerre est comme H2O. C’est de l’équipement, de la technologie, du courage, de la compétence, une intégration des capacités, de la peur, de la lâcheté, le tout mélangé dans une imprédictible nature fondamentale de la guerre ». Cette déclaration met bien en avant des qualités et défauts tous humains, que l’on ne retrouve certainement pas (encore) dans les machines qui tiennent les armes.

Bien évidemment, cette nature de la guerre évolue avec les mœurs de la société, avec sa technologie, et il est logique qu’elle suive le cours de l’intelligence artificielle, chaque état souhaitant prendre l’ascendant sur son voisin ou assurer sa propre sécurité.

Néanmoins, comme il le souligne si bien « si on en arrive au point où tout le pilotage est complètement automatisé, nous sommes tous des spectateurs. Cela ne sert plus alors un but politique. Et le conflit devient un problème social qui nécessite une solution sociale, une relation gens – humains ».

On comprend donc que l’intelligence artificielle risque fortement de dénaturer la guerre, et va donc dans le sens d’Elon Musk et de 116 experts en intelligence artificielle qui demandent le bannissement des robots tueurs : la perspective du film « Terminator » ne parait plus tellement tirée de la dystopie.

Etat de « l’art »

Si les recherches dans le domaine sont Top Secret, de nombreux pays ont avoués être en train de développer des armes létales autonomes : Etats-Unis, Chine, Russie, Iraël, Corée du Sud… tous disposent de robots (mobiles ou non) capables d’ouvrir le feu sur des humains sans la moindre intervention d’opérateurs.

Une véritable course à l’armement, similaire à celle de la bombe atomique après la Seconde Guerre Mondiale, est en cours. Tous se justifient du bon sentiment de vouloir « sauver la vie de leurs soldats », mais qu’en est-il réellement ? Est-ce que la prochaine guerre sera une guerre entre robots retransmise à la TV et sur internet ?

Hélas, la guerre n’est pas qu’une affaire de militaires et de soldats, puisque la plupart des armes terminent entre les mains de terroristes. La perspective de voir un robot tueur débarquer dans une école aux Etats-Unis inquiète de plus en plus de monde, à tel point que les forces d’intervention sont maintenant entraînées pour gérer ce type de situation. Leur principal recours : utiliser un robot tueur pour mettre hors service une telle arme (drone, grenades/IEM, visée automatique, puissance de feu importante, etc…).

Voici une petite vidéo d’une scène possible dans quelques années (c’est donc une fiction… pour l’instant), réalisée par un ensemble d’experts militant contre les robots tueurs et cette pratique des gouvernements.

Crédit de l’image de couverture : skeeze – Pixabay License

![Spark 3 : à la découverte des RDD [Part 2]](https://penseeartificielle.fr/wp-content/uploads/2022/02/fire-1905608_1280-218x150.jpg)

![Installation de Spark 3 sous Windows [Part 1]](https://penseeartificielle.fr/wp-content/uploads/2022/02/pexels-fabiano-rodrigues-1662298-218x150.jpg)

[…] – https://penseeartificielle.fr/nature-guerre-artificielle-evolue-menace-humanite/ […]