Les conditions générales d’utilisation… Tout le monde les voit passer lorsqu’il s’inscrit sur un site internet ou souscrit à un service. Cependant, seuls 23% des utilisateurs les lisent, et la plupart pensent qu’elles ne sont là que pour protéger les entreprises.

En réalité, les CGU servent plus ou moins à nous protéger et à interdire aux sociétés les abus (comme la vente de données personnelles ou leur exploitation), au même titre que la CNIL agit directement sur le stockage des données.

Des chercheurs de l’Ecole Polytechnique Fédérale de Lausanne (EPFL) en Suisse ont mis en place une intelligence artificielle capable de lire l’ensemble 3294 mots moyens qu’il y a dans les CGU et nous éviter ainsi le travail fastidieux et incertain qu’on est « obligés » de faire. L’IA peut alors prédire si le site présente un risque ou des failles dans ses conditions qu’il pourrait exploiter !

De quoi ne plus offrir 277€ partout où l’on s’inscrit. Après un rappel sur les problématiques liées aux CGU, l’IA est présentée.

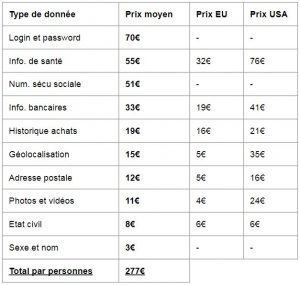

Que valent vos données personnelles

ITSocial relayait, il y a quelques années de ça, une étude de Trend Micro cherchant à évaluer le prix de nos données personnelles. Contre toute attente, celles-ci valent plusieurs centaines d’euros.

Par exemple, un nom d’utilisateur et un mot de passe valent en moyenne 70€ car ils permettent de pirater la plupart des autres comptes d’une personne (on a tendance à utiliser le même mot de passe partout). Les informations de santé valent dans les 50€. Si pour nous elles sont uniquement à caractère (très) personnel et ne « servent à rien », on se rend bien compte que les principaux acheteurs sont les banques et les assurances. Connaître l’état de santé d’une personne demandant un crédit permet aux algorithmes de machine learning d’évaluer précisément le risque encouru par l’organisme et le retour sur investissement attendu…

Les autres données ont moins de valeur, mais on peut gager qu’en 2018 elles auront pris de l’importance. En particulier, une donnée non chiffrée mais de plus en plus exploitée, les comptes sociaux associés à une personne.

Par conséquent, à nos yeux nos données personnelles sont précieuses car elles sont… personnelles, mais aux yeux des entreprises/sites internet à qui on les donne de manière naturelle, par habitude maintenant, elles représentent une somme d’argent considérable.

N’avez-vous jamais reçu d’appels téléphoniques ou de mails suite à une inscription quelque part ? Une banque d’emails de 200 000 personnes vaut d’ailleurs environ 350€ à l’achat.

Un flou qui arrange bien les sociétés

Sans vouloir jeter la pierre aux sociétés qui, au fond, exploitent « simplement » tout ce qu’on veut bien leur « donner », il est une pratique abusive qui diminie encore plus notre envie de lire les CGU : les CGU qui changent !

Comme on l’a déjà dit, seulement 23% des personnes lisent les CGU (souvent en diagonale). Simplement, elles sont rarement facilement compréhensibles : phrases alambiquées, cas en marge, paragraphes inutiles ou purement juridique découragent beaucoup de personnes.

Il y a un frein également dans le changement fréquent des conditions. Régulièrement, des mails informant de la mise à jour de tel ou tel paragraphe notifie les usagers d’un service, les obligeant à une veille constante et à un travail régulier s’ils veulent garder le contrôle sur l’utilisation de leurs données…

Dernier problème : il n’existe pas vraiment de modèle à respecter, et la plupart des webmasters ne sont ni informés ni contrôlés. Par exemple, pour Pensée Artificielle, on a eu recours à un avocat pour « écrire » et valider nos CGU afin de couvrir l’ensemble des cas possibles. Néanmoins, dans 80% des cas, les webmasters se content de copier les CGU d’un autre site, en changeant deux ou trois paragraphes. Conséquence : elles ne couvrent pas la moitié des situations possibles.

Une IA pour nous rendre la vie meilleure et surtout nous donner conscience des dangers : Polisis

De ce constat alarmant et de la nécessité de lire, comprendre, analyser des termes et conditions d’utilisation de manière récurrente, est né le projet de l’EPFL et leur intelligence artificielle : Polisis (pour privacy policy analysis).

Notez dès à présent que vous pouvez tester n’importe quel site dont les CGU sont en anglais, comme par exemple Twitter, Facebook ou Google, via le site web de Polisis ou les extensions Chrome/Firefox !

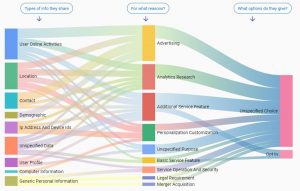

Comme le dit Hamza Harkous, un chercheur à l’EPFL, ils ont converti le texte, illisible et peu engageant, en de superbes graphiques colorés dont on peut facilement extraire l’information « Notre programme utilise de simples graphes et des codes couleurs pour montrer à l’utilisateur exactement comment leur donnée peut être utilisée ».

Entraîné sur 130 000 sites internet, l’algorithme est très performant (précision de 88.4%) a fait l’objet d’une publication. On y apprend notamment comment il est construit :

- La problématique est divisée en plusieurs petits fragments de texte, des « segments » que Polisis va devoir remplir. On retrouve par exemple une sous-partie dédiée à l’utilisation des données, à la conservation des données, aux notions de sécurité (data center…), ainsi qu’à beaucoup d’autres valeurs :

- Ensuite, chaque segment rattaché à des portions de texte est annoté à partir d’un ensemble d’étiquettes disponibles et caractérisant les politiques : on associe des classes aux segments et non de manière générique, approche que l’on a vu tout récemment dans notre article sur la reconnaissance vocale.

D’un point de vue plus technique, on apprend que le coeur de l’algorithme repose sur un réseau de neurones qui peut prédire 10 classes mères (cf schéma ci-dessus) et 122 sous-classes « fine-grained » (c’est-à-dire des sous-espèces/races), le tout organisé en 3 couches principales :

- Application layer = cette couche sert à fournir les sous-classes répondant à la requête de l’utilisateur (donc à ce qu’il demande), via le module de recherche. Elle agrège donc les données (par comparaison de classes). Deux types d’entrées sont possibles : des requêtes structurées et libres (cf PriBot, un chatbot développé par la même équipe qui fait exactement comme Polisis via un échange textuel avec un utilisateur !).

- Data layer = elle sert à parcourir la page des CGU et à en extraire toutes les informations. Les segments sont ainsi formés ici et traités/alimentés en classe dans la couche ML. On y trouve donc extraction, gestion de liste et segmentation.

- Machine Learning layer = après les couches d’agrégation (entrée) et de traitement (entrée/sortie), on a la couche qui porte l’algorithme de classification, associant à chaque segment un ensemble de classes. Il s’appuie sur des réseaux de neurones convolutionnels (CNN).

Conclusion

Toutefois, être conscient des failles d’un site internet n’implique pas forcément la prise d’action des internautes, qui préfèrent bénéficier d’un service plutôt que d’y renoncer, sous prétexte qu’on leur demande leur adresse postale. Une habitude qu’il faudra changer, si on veut que les sociétés changent aussi (en notre faveur), même si des projets tendant à renverser la balance pourraient bientôt voir le jour…

Si vous voulez revoir nos conditions d’utilisation, qui ont été rédigées d’un point de vue utilisateur, avec un véritable respect de vos données, vous avez à la fois les CGU et notre engagement sur la vie privée, ainsi que notre dépôt auprès de la CNIL !

Car avant d’être webmasters, nous sommes des citoyens, et Pensée Artificielle est fait pour vous.

Crédit de l’image de couverture : TheDigitalArtist – Pixabay License

![Spark 3 : à la découverte des RDD [Part 2]](https://penseeartificielle.fr/wp-content/uploads/2022/02/fire-1905608_1280-218x150.jpg)

![Installation de Spark 3 sous Windows [Part 1]](https://penseeartificielle.fr/wp-content/uploads/2022/02/pexels-fabiano-rodrigues-1662298-218x150.jpg)