Rendre une machine capable de comprendre un humain a toujours été un enjeu majeur pour nous, que ce soit au niveau de l’analyse vocale ou de la génération de texte, contextualisé. Mais rendre un humain capable de comprendre un animal, rêve millénaire, redéfinirait complètement nos interactions avec la Nature.

Une équipe pluridisciplinaire, rassemblée autour de l’Université de Géorgie (USA), propose une solution innovante, basée sur 5 ans d’enregistrements et de travail, pour enfin comprendre… la volaille !

Si cela peut paraitre dérisoire, les retombées commerciales de ce langage des poules via un algorithme sont énormes (amélioration des conditions de vie des bêtes, meilleure rentabilité, humanisation…), comme nous allons le voir, et laisse présager des résultats similaires avec d’autres espèces, tels les bovins ou voire même nos animaux de compagnie.

Le langage des poules et des coqs

Kevin Mitchell, en charge d’un million de poules pour Wilcox Farms en Oregon, comprend grâce à ses nombreuses années d’expériences ce que « veulent les bêtes ».

Le matin, elles sont bruyantes et gloussent : « elles sont en très bonne santé et heureuse », explique-t-il. Lorsque les poules pondent, elles émettent des sons différents, proches de la victoire, et on parle de caquetage.

Concernant les coqs, leur comportement peut varier à l’approche d’un prédateur aérien (comme un aigle ou un faucon repéré par son ombre). S’ils peuvent se mettre à l’abri rapidement, ils émettront des cris courts d’alarme, très aigüe. A l’inverse, si le silence leur permet d’augmenter leurs chances de survie, ils ne diront pratiquement rien, et ce sera le signal d’alarme.

Enfin, son auquel nous sommes habitués : les « clouc » courts et réguliers à notre arrivée, qui signifient en réalité l’approche d’un groupe de prédateurs terrestres…

De manière plus pragmatique, chercheurs, ingénieurs et industriels se sont réunis pour mieux comprendre les bruits des volatiles. Aujourd’hui, grâce à des algorithmes de machine learning, ils sont en mesure de déterminer si la température de la pièce est trop élevée ou basse, si des bêtes sont malades (au niveau respiratoire), si le niveau d’ammoniaque augmente (à cause des déjections animales), et de manière générale si le poulailler se porte bien et est « heureux ».

Pourquoi faut-il comprendre nos poules ?

Dix-neuf milliard de poulets domestiqués dans le monde, qui représentent plusieurs milliards d’euros rien qu’en exportation/importation.

Au vu des sommes impliquées, les éleveurs font tout leur possible pour améliorer les conditions de leurs bêtes de manière non-intrusive. La méthode présentée dans cet article est donc un grand pas un avant, puisqu’elle ne nécessite que de placer des microphones dans le volailler et de lancer l’algorithme entraîné.

Mathilde Lyon écrivait « Pour ramasser des œufs de bonne qualité, il convient de bien nourrir vos poules, de veiller au manque de calcium et de respecter leur cycle de ponte. », et Wilcox Farms semble être convaincue, vu les moyens investis et le nombre de fermiers que la société a réunie derrière elle, enthousiasmé par les perspectives pour leur production, le bien-être de leurs animaux, et la qualité « garantie ».

Bien évidemment, pour que l’analyse vocale des poules serve à quelque chose, il faut un mécanisme de rétro-action à partir des prédictions : la plupart des fermes sont devenues hyper connectées, avec des dizaines voire centaines de capteurs en tout genre, des régulateurs, et autres systèmes intelligents. Le marché est donc prêt à aller de l’avant, surtout si le score de prédiction reste supérieur à 90% pour la majorité des « phrases » que peuvent dire les poules et coqs.

La solution technique et algorithmique

Si le Scientific American rapporte tous ces schémas de parole sur les poules et les coqs, les publications derrière peuvent être retrouvées sur IEEE, NCBI et autres journaux.

Pour les expériences décrites ci-avant, voici ce qu’il se cache derrière…

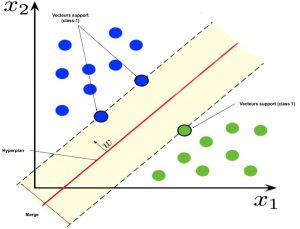

On a donc des enregistrements audio réguliers sur des temps assez longs (30 minutes) qui servent à entraîner deux algorithmes SVM (Support Vector Machine), connus en Machine Learning pour leur efficacité.

Un générateur de features Correlation-based Feature Selection (CFS) vient s’intercaler dans le processus afin de réduire la dimension de l’entrée (la totalité de la piste audio ne peut pas et ne doit pas être envoyée à SVM, il faut un pré-traitement pour ne garder que les parties significatives). Comme souvent, c’est cette partie de data preprocessing qui détermine si le système fonctionnera ou non, car les algorithmes (y compris de deep learning) voient leurs performances varier du tout au tout si on les alimente mal lors de l’entraînement.

Pour revenir un peu sur les SVM, ils ont été séparés en deux fonctionnalités : la détection de stress, qui est simplement une prédiction d’un niveau, et si un certain seuil est atteint, une classification du stress grâce à du multi-classe. Si on aurait pu envoyer directement les features au second SVM, il faut noter que c’est une assez mauvaise pratique qui donne des résultats moins pertinents : mieux vaut entraîner ses algorithmes à des tâches spécifiques, plutôt qu’à de multiples prédictions !

Ici par exemple, il aurait été compliqué de donner autant d’importance à « stress Normal » et à « (stress Elevé et stress dû à la nourriture) OU (stress Elevé et stress dû au bruit) », par exemple (on comprend ainsi que le SVM aura du mal à être pertinent sur les deux prédictions).

Une affaire à suivre

Si aujourd’hui on a parlé de la volaille, beaucoup d’articles sont publiés régulièrement sur des travaux similaires autour de nos animaux de compagnie ! Le jour où on pourra les comprendre (automatiquement) n’est plus très loin… même si on le fait déjà naturellement depuis des millénaires.

Crédit de l’image de couverture : JamesDeMers – Pixabay License